0

Suivez-nous

Bulletin

Avez-vous déjà eu l’expérience de relire une phrase plusieurs fois pour vous rendre compte que vous ne la comprenez toujours pas ? Comme cela a été enseigné à de nombreux étudiants de première année, lorsque vous réalisez que vous faites tourner vos roues, il est temps de changer votre approche.

Ce processus, prendre conscience de quelque chose qui ne fonctionne pas et ensuite changer ce que vous faites, est l’essence même de métacognitionou penser à penser.

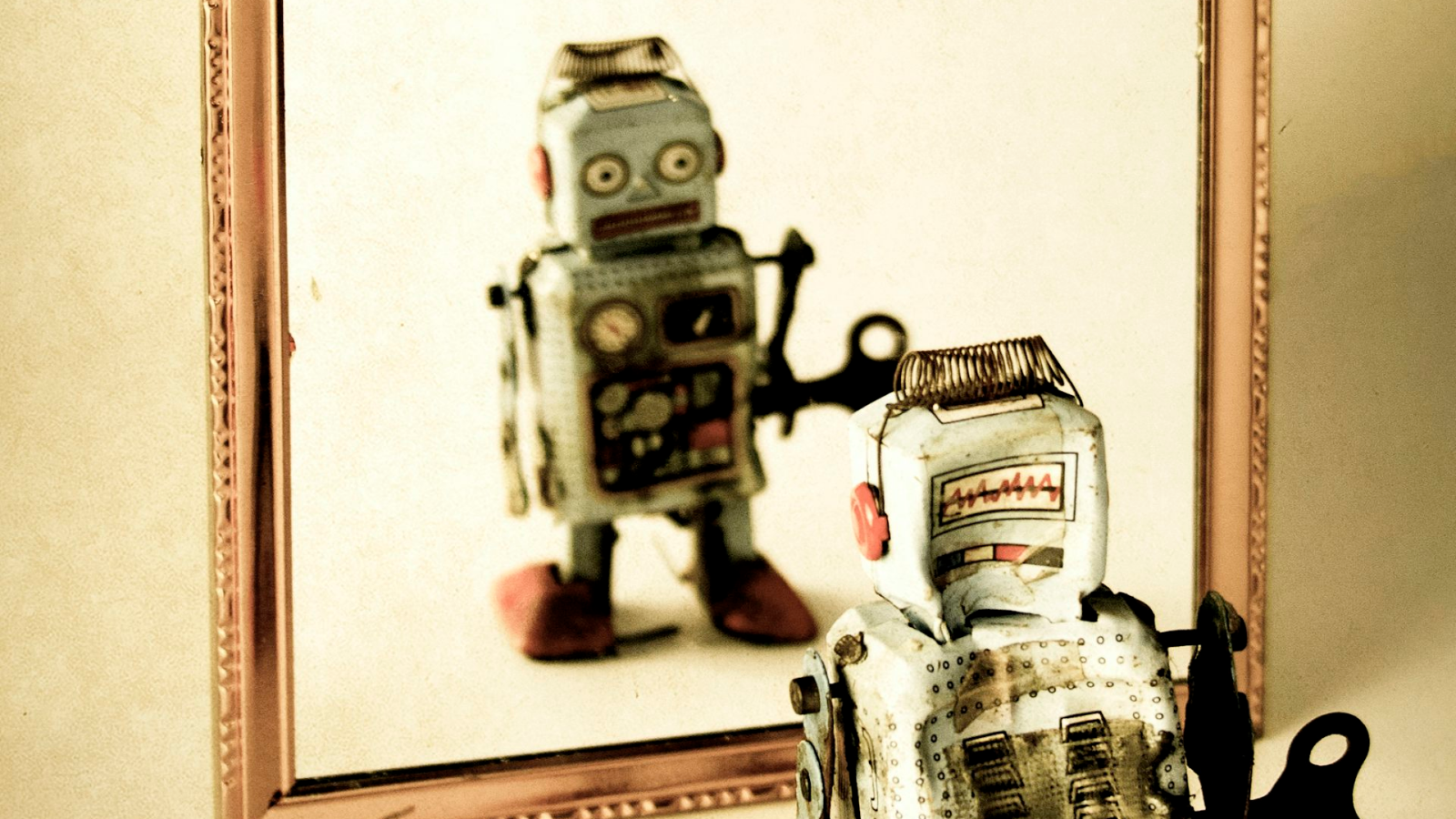

Mes collègues Charles Courchaine, Hefei Qiu et Josué Iacoboni et moi travaillent pour changer cela. Nous avons développé un cadre mathématique conçu pour permettre la génération Systèmes d’IAen particulier de grands modèles de langage comme ChatGPT ou Claude, pour surveiller et réguler leurs propres processus « cognitifs » internes. Dans un certain sens, vous pouvez le considérer comme donner à l’IA générative un monologue intérieurun moyen d’évaluer sa propre confiance, de détecter la confusion et de décider quand réfléchis plus fort à propos d’un problème.

Pourquoi les machines ont besoin d’être conscientes d’elles-mêmes

Les systèmes d’IA générative d’aujourd’hui sont remarquablement performants mais fondamentalement inconscients. Ils génèrent des réponses sans vraiment savoir à quel point je suis confiant ou confus Leur réponse pourrait être, si elle contient des informations contradictoires ou si un problème mérite une attention particulière. Ce limitation devient critique lorsque l’IA générative incapacité à reconnaître sa propre incertitude peut avoir de graves conséquences, en particulier dans les applications à enjeux élevés telles que le diagnostic médical, les conseils financiers et la prise de décision en matière de véhicules autonomes.

Par exemple, considérons un système d’IA générative médicale analyser les symptômes. Il peut suggérer en toute confiance un diagnostic sans aucun mécanisme permettant de reconnaître les situations où cela pourrait être le cas. il est plus approprié de faire une pause et de réfléchircomme « Ces symptômes se contredisent » ou « C’est inhabituel, je devrais y réfléchir plus attentivement. »

Développer une telle capacité nécessiterait métacognitionce qui implique à la fois la capacité de surveiller son propre raisonnement grâce à la conscience de soi et contrôler la réponse grâce à l’autorégulation.

Inspiré de la neurobiologienotre cadre vise à donner à l’IA générative un semblant de ces capacités en utilisant ce que nous appelons un vecteur d’état métacognitif, qui est essentiellement une mesure quantifiée de l’état « cognitif » interne de l’IA générative. à travers cinq dimensions.

5 dimensions de la conscience de soi de la machine

Une façon d’y penser cinq dimensions est d’imaginer donner à un système d’IA générative cinq capteurs différents pour sa propre réflexion.

- Conscience émotionnelle, pour l’aider à suivre les contenus chargés d’émotion, ce qui peut être important pour prévenir les sorties nuisibles.

- Évaluation de l’exactitude, qui mesure le degré de confiance du grand modèle de langage quant à la validité de sa réponse.

- L’expérience matching, où il vérifie si la situation ressemble à quelque chose qu’il a déjà rencontré.

- Détection des conflits, afin d’identifier les informations contradictoires nécessitant une résolution.

- Importance du problème, pour l’aider à évaluer les enjeux et l’urgence de prioriser les ressources.

Nous quantifions chacun de ces concepts dans un cadre mathématique global pour créer le vecteur d’état métacognitif et l’utilisons pour contrôler des ensembles de grands modèles de langage. Essentiellement, le vecteur d’état métacognitif convertit les auto-évaluations qualitatives d’un grand modèle de langage en signaux quantitatifs qu’il peut utiliser pour contrôler ses réponses.

Par exemple, lorsque la confiance d’un grand modèle de langage dans une réponse tombe en dessous d’un certain seuil, ou lorsque les conflits dans la réponse dépassent certains niveaux acceptables, il peut passer d’un traitement rapide et intuitif à un raisonnement lent et délibératif. C’est analogue à ce que les psychologues appellent Système 1 et Système 2 penser chez les humains.

Diriger un orchestre

Imaginez un grand ensemble de modèles de langage comme un orchestre dans lequel chaque musicien – un grand modèle de langage individuel – intervient à certains moments en fonction des signaux reçus du chef d’orchestre. Le vecteur d’état métacognitif agit comme la conscience du chef d’orchestre, surveillant constamment si l’orchestre est en harmonie, si quelqu’un est désaccordé ou si un passage particulièrement difficile nécessite une attention particulière.

Lorsqu’il interprète une pièce familière et bien répétée, comme une simple mélodie folklorique, l’orchestre joue facilement à l’unisson, rapidement et efficacement, avec un minimum de coordination nécessaire. Il s’agit du mode Système 1. Chaque musicien connaît son rôle, les harmonies sont simples et l’ensemble fonctionne presque automatiquement.

Mais lorsque l’orchestre est confronté à une composition de jazz complexe avec des signatures rythmiques contradictoires, des harmonies dissonantes ou des sections nécessitant une improvisation, les musiciens ont besoin d’une plus grande coordination. Le chef d’orchestre demande aux musiciens d’inverser les rôles : certains deviennent chefs de section, d’autres assurent l’ancrage rythmique et des solistes émergent pour des passages spécifiques.

C’est le genre de système que nous espérons créer dans un contexte informatique en implémentant notre framework, en orchestrant des ensembles de grands modèles de langage. Le vecteur d’état métacognitif informe un système de contrôle qui agit comme chef d’orchestre, lui disant de passer en mode système 2. Il peut ensuite demander à chaque grand modèle de langage d’assumer différents rôles – par exemple, critique ou expert – et de coordonner leurs interactions complexes en fonction de l’évaluation métacognitive de la situation.

Impact et transparence

Les implications vont bien au-delà de rendre l’IA générative légèrement plus intelligente. Dans le domaine des soins de santé, un système d’IA générative métacognitive pourrait reconnaître les symptômes qui ne correspondent pas aux schémas typiques et transmettre le problème aux experts humains plutôt que de risquer un diagnostic erroné. En éducation, il pourrait adapter les stratégies pédagogiques lorsqu’il détecte une confusion chez les élèves. Dans le cadre de la modération de contenu, cela pourrait identifier des situations nuancées nécessitant un jugement humain plutôt que l’application de règles rigides.

Peut-être plus important encore, notre cadre rend la prise de décision en matière d’IA générative plus transparente. Au lieu d’une boîte noire qui produit simplement des réponses, nous disposons de systèmes capables d’expliquer leur niveau de confiance, d’identifier leurs incertitudes et de montrer pourquoi ils ont choisi des stratégies de raisonnement particulières.

Cette interprétabilité et cette explicabilité sont cruciales pour instaurer la confiance dans les systèmes d’IA, en particulier dans les secteurs réglementés ou les applications critiques pour la sécurité.

La route à suivre

Notre cadre ne donne pas aux machines une conscience ou une véritable conscience de soi au sens humain du terme. Au lieu de cela, notre espoir est de fournir une architecture informatique pour allouer les ressources et améliorer les réponses, qui constitue également un premier pas vers des approches plus sophistiquées pour une métacognition artificielle complète.

Le prochaine phase dans notre travail implique de valider le cadre avec des tests approfondis, de mesurer comment la surveillance métacognitive améliore les performances dans diverses tâches et d’étendre le cadre pour commencer à raisonner sur le raisonnement, ou métaraisonnement. Nous sommes particulièrement intéressés par les scénarios dans lesquels la reconnaissance de l’incertitude est cruciale, comme dans les diagnostics médicaux, le raisonnement juridique et la génération d’hypothèses scientifiques.

Notre vision ultime est celle de systèmes d’IA génératifs qui ne se contentent pas de traiter les informations, mais comprennent leurs limites et leurs atouts cognitifs. Cela signifie des systèmes qui savent quand être confiants et quand être prudents, quand penser vite et quand ralentir, et quand ils sont qualifiés pour répondre et quand ils doivent s’en remettre aux autres.

Cet article édité est republié à partir de La conversation sous licence Creative Commons. Lire le article original.