0

Suivez-nous

Bulletin

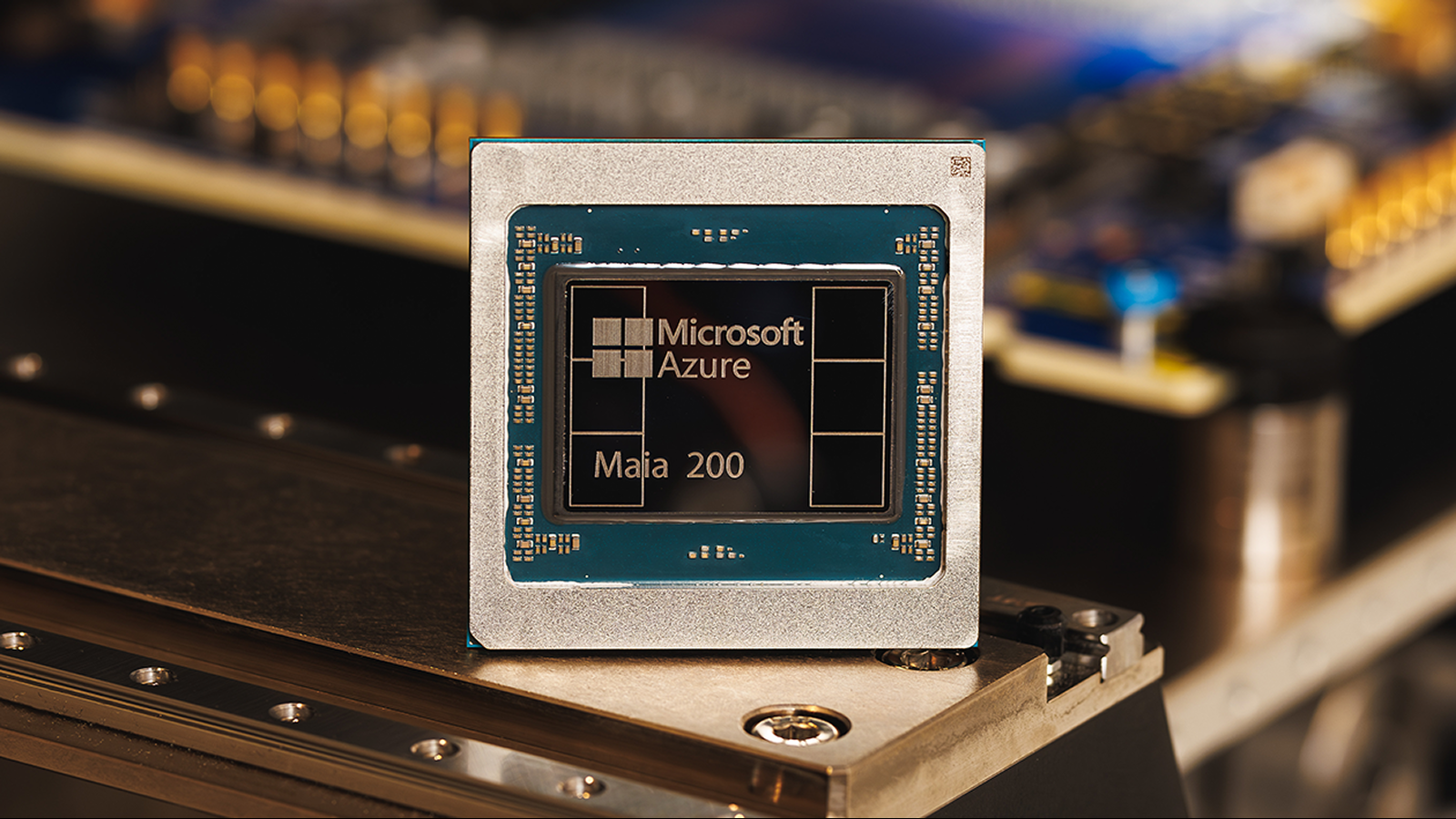

Microsoft a dévoilé sa nouvelle puce accélératrice Maia 200 pour intelligence artificielle (IA) qui est trois fois plus puissante que le matériel de concurrents comme Google et Amazon, affirment les représentants de l’entreprise.

Cette puce la plus récente sera utilisée dans l’inférence de l’IA plutôt que dans la formation, alimentant les systèmes et les agents utilisés pour faire des prédictions, fournir des réponses aux requêtes et générer des résultats basés sur les nouvelles données qui leur sont transmises.

La nouvelle puce offre des performances de plus de 10 pétaflops (1015 opérations en virgule flottante par seconde), a déclaré Scott Guthrie, vice-président exécutif du cloud et de l’IA chez Microsoft, dans un article de blog. Il s’agit d’une mesure de performance en calcul intensif, où le les supercalculateurs les plus puissants du monde peut atteindre plus de 1 000 pétaflops de puissance.

La nouvelle puce a atteint ce niveau de performances dans une catégorie de représentation des données connue sous le nom de « précision 4 bits (FP4) » – un modèle hautement compressé conçu pour accélérer les performances de l’IA. Maia 200 offre également 5 PFLOPS de performances en précision 8 bits (FP8). La différence entre les deux est que le FP4 est beaucoup plus économe en énergie mais moins précis.

« En termes pratiques, un nœud Maia 200 peut exécuter sans effort les plus grands modèles actuels, avec une grande marge pour des modèles encore plus grands à l’avenir », a déclaré Guthrie dans le billet de blog. « Cela signifie que Maia 200 offre 3 fois les performances FP4 de l’Amazon Trainium de troisième génération et des performances FP8 supérieures au TPU de septième génération de Google. »

Chips, salut

Maia 200 pourrait potentiellement être utilisé pour des charges de travail spécialisées en IA, telles que l’exécution de LLM plus importants à l’avenir. Jusqu’à présent, les puces Maia de Microsoft n’ont été utilisées que dans l’infrastructure cloud Azure pour exécuter des charges de travail à grande échelle pour les propres services d’IA de Microsoft, notamment Copilot. Cependant, Guthrie a noté qu’il y aurait « une plus grande disponibilité client à l’avenir », signalant que d’autres organisations pourraient exploiter Maia 200 via le cloud Azure, ou que les puces pourraient potentiellement un jour être déployées dans des centres de données ou des piles de serveurs autonomes.

Guthrie a déclaré que Microsoft affiche des performances par dollar 30 % supérieures à celles des systèmes existants grâce à l’utilisation du processus de 3 nanomètres mis au point par la Taiwan Semiconductor Manufacturing Company (TSMC), la fabricant le plus important au mondepermettant 100 milliards de transistors par puce. Cela signifie essentiellement que Maia 200 pourrait être plus rentable et plus efficace pour les charges de travail d’IA les plus exigeantes que les puces existantes.

Maia 200 possède quelques autres fonctionnalités ainsi que de meilleures performances et efficacité. Il comprend par exemple un système de mémoire qui peut aider à conserver les poids et les données d’un modèle d’IA au niveau local, ce qui signifie que vous auriez besoin de moins de matériel pour exécuter un modèle. Il est également conçu pour être intégré rapidement aux centres de données existants.

Maia 200 devrait permettre aux modèles d’IA de fonctionner plus rapidement et plus efficacement. Cela signifie que les utilisateurs d’Azure OpenAI, tels que les scientifiques, les développeurs et les entreprises, pourraient bénéficier d’un meilleur débit et de meilleures vitesses lors du développement d’applications d’IA et de l’utilisation de GPT-4 dans leurs opérations.

Il est peu probable que ce matériel d’IA de nouvelle génération perturbe l’utilisation quotidienne de l’IA et des chatbots pour la plupart des gens à court terme, car le Maia 200 est conçu pour les centres de données plutôt que pour le matériel grand public. Cependant, les utilisateurs finaux pourraient constater l’impact de Maia 200 sous la forme de temps de réponse plus rapides et de fonctionnalités potentiellement plus avancées de Copilot et d’autres outils d’IA intégrés aux produits Windows et Microsoft.

Maia 200 pourrait également améliorer les performances des développeurs et des scientifiques qui utilisent l’inférence de l’IA via les plateformes Microsoft. Ceci, à son tour, pourrait conduire à des améliorations du déploiement de l’IA sur des projets de recherche à grande échelle et sur des éléments tels que la modélisation météorologique avancée, les systèmes et compositions biologiques ou chimiques.