0

Suivez-nous

Bulletin

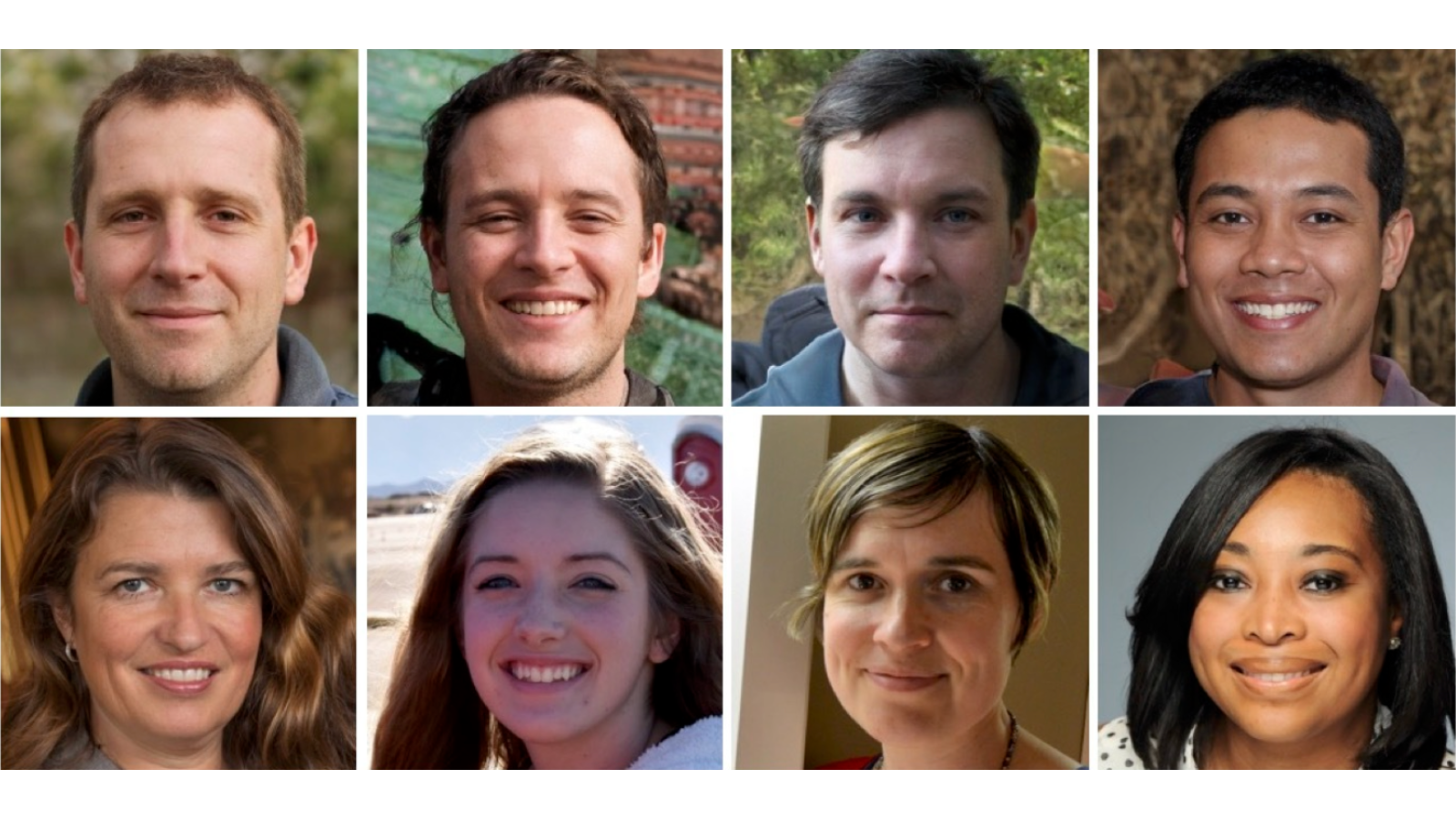

Images de visages générées par intelligence artificielle (IA) sont si réalistes que même les « super-identifiants » – un groupe d’élite doté de capacités de traitement facial exceptionnellement fortes – ne valent pas mieux que la chance de détecter les faux visages.

Les personnes dotées de capacités de reconnaissance typiques sont pires que le hasard : le plus souvent, elles pensent que les visages générés par l’IA sont réels.

« Je pense qu’il était encourageant de constater que notre procédure d’entraînement assez courte a considérablement augmenté les performances dans les deux groupes », a déclaré l’auteur principal de l’étude. Katie Grayprofesseur agrégé de psychologie à l’Université de Reading au Royaume-Uni, a déclaré à Live Science.

Étonnamment, la formation a augmenté la précision de manière similaire chez les super-reconnaisseurs et les reconnaisseurs typiques, a déclaré Gray. Étant donné que les super-identifiants sont plus efficaces pour repérer les faux visages au départ, cela suggère qu’ils s’appuient sur un autre ensemble d’indices, et pas seulement sur des erreurs de rendu, pour identifier les faux visages.

Gray espère que les scientifiques seront en mesure d’exploiter les capacités de détection améliorées des super-reconnaisseurs pour mieux repérer les images générées par l’IA à l’avenir.

« Pour détecter au mieux les visages synthétiques, il pourrait être possible d’utiliser des algorithmes de détection d’IA avec une approche humaine dans la boucle – où cet humain est un SR (super reconnaisseur) formé », ont écrit les auteurs dans l’étude.

Détection des deepfakes

Ces dernières années, il y a eu une vague d’images générées par l’IA en ligne. Les visages Deepfake sont créés à l’aide d’un algorithme d’IA en deux étapes appelé réseaux contradictoires génératifs. Tout d’abord, une fausse image est générée à partir d’images du monde réel, puis l’image résultante est examinée par un discriminateur qui détermine si elle est réelle ou fausse. Avec l’itération, les fausses images deviennent suffisamment réalistes pour dépasser le discriminateur.

Ces algorithmes se sont maintenant améliorés à tel point que les individus sont souvent trompés en pensant que les faux visages sont plus « réels » que les vrais visages – un phénomène connu sous le nom de «hyperréalisme« .

En conséquence, les chercheurs tentent désormais de concevoir des régiments d’entraînement capables d’améliorer les capacités des individus à détecter les visages de l’IA. Ces formations mettent en évidence erreurs de rendu courantes sur les visages générés par l’IA, tels que le visage ayant une dent du milieu, une racine des cheveux étrange ou une texture de peau d’apparence non naturelle. Ils soulignent également que les faux visages ont tendance à être plus proportionnel que les vrais.

En théorie, les soi-disant super-identifiants devraient être plus efficaces pour détecter les contrefaçons que la personne moyenne. Ces super reconnaisseurs sont des individus qui excellent dans les tâches de perception et de reconnaissance faciales, dans lesquelles on peut leur montrer deux photographies d’individus inconnus et leur demander d’identifier s’il s’agit de la même personne ou non. Mais à ce jour, peu d’études ont examiné la capacité des super-identifiants à détecter les faux visages et si l’entraînement peut améliorer leurs performances.

Pour combler cette lacune, Gray et son équipe ont mené une série d’expériences en ligne comparant les performances d’un groupe de super-reconnaisseurs à celles des reconnaisseurs classiques. Les super reconnaisseurs ont été recrutés parmi les Laboratoire de reconnaissance faciale et vocale de Greenwich base de données des bénévoles ; ils s’étaient classés parmi les 2 % des individus les plus performants dans des tâches où on leur montrait des visages inconnus et devaient s’en souvenir.

Dans la première expérience, l’image d’un visage apparaissait à l’écran et était soit réelle, soit générée par ordinateur. Les participants avaient 10 secondes pour décider si le visage était réel ou non. Les super-identifiants n’ont pas obtenu de meilleurs résultats que s’ils avaient deviné au hasard, repérant seulement 41 % des visages de l’IA. Les outils de reconnaissance typiques n’ont identifié correctement qu’environ 30 % des contrefaçons.

Chaque cohorte différait également par la fréquence à laquelle ils pensaient que les vrais visages étaient faux. Cela s’est produit dans 39 % des cas pour les super-reconnaisseurs et dans environ 46 % pour les reconnaisseurs typiques.

L’expérience suivante était identique, mais incluait un nouvel ensemble de participants qui ont reçu une session de formation de cinq minutes au cours de laquelle on leur a montré des exemples d’erreurs sur les visages générés par l’IA. Ils ont ensuite été testés sur 10 visages et ont reçu des informations en temps réel sur leur précision dans la détection des contrefaçons. La dernière étape de la formation impliquait un récapitulatif des erreurs de rendu à surveiller. Les participants ont ensuite répété la tâche originale de la première expérience.

La formation a considérablement amélioré la précision de la détection, avec des super-reconnaisseurs détectant 64 % des faux visages et des reconnaisseurs typiques en remarquant 51 %. Le taux auquel chaque groupe qualifiait à tort de vrais visages de faux était à peu près le même que celui de la première expérience, avec des super-identifiants et des reconnaisseurs typiques évaluant les vrais visages comme « non réels » dans 37 % et 49 % des cas, respectivement.

Les participants formés avaient tendance à mettre plus de temps à scruter les images que les participants non formés : les dispositifs de reconnaissance typiques ralentissaient d’environ 1,9 seconde et les super-reconnaisseurs de 1,2 seconde. Gray a déclaré qu’il s’agissait d’un message clé pour quiconque tente de déterminer si un visage qu’il voit est réel ou faux : ralentissez et inspectez réellement les traits.

Il convient toutefois de noter que le test a été réalisé immédiatement après que les participants ont terminé la formation. On ne sait donc pas exactement combien de temps dure l’effet.

« La formation ne peut pas être considérée comme une intervention durable et efficace, car elle n’a pas été testée à nouveau », Meike Ramonprofesseur de science appliquée des données et expert en traitement des visages à la Haute école spécialisée de Berne en Suisse, a écrit dans une revue de l’étude menée avant sa publication.

Et comme des participants distincts ont été utilisés dans les deux expériences, nous ne pouvons pas être sûrs dans quelle mesure la formation améliore les capacités de détection d’un individu, a ajouté Ramon. Cela nécessiterait de tester deux fois le même groupe de personnes, avant et après la formation.